東京大学の研究グループが提案している「Invoked Computing」と呼ばれる概念は、身の回りのあらゆるものをコンピューターの操作画面や通信機器に変えてしまおうというものです。

この技術が普及すれば、人々は生活の中において操作機器などのデバイスから開放されるかもしれません。

この技術では、人間の動作によってコンピュータは人間の意志を認識します。例えば、バナナを受話器のように持てば、コンピュータは「こいつ電話がしたいんだな?」という風に認識するということです。その認識に対応して、コンピュータは人間にサービスを提供します。

電話を使いたいときには、その動作をするだけで通話ができるようになり、ノートパソコンを使いたいときには、その動作をするだけでディスプレイやキーボードが表示されるといった具合になります。

これまでは機能が詰め込まれたスマートフォンの操作をいちいち学んだり、ノートパソコンを持ち歩かなくてはいけませんでしたが、この技術があれば、そういったデバイスによる制限から自由になることができます。すなわちそれが、ユビキタス拡張現実です。

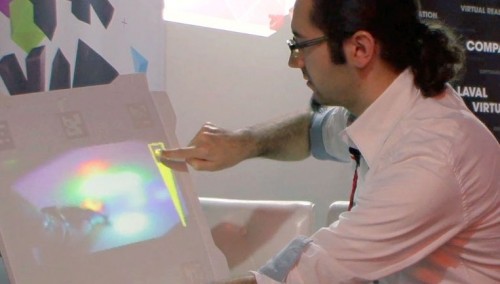

「Invoked Computing」は、フランスで開催された国際カンファレンス「LAVAL VIRTUAL(ラヴァル・ヴァーチャル)2011」でグランプリを獲得し、その後、東京の「デジタルコンテンツEXPO」において、コンセプトを実証するためのプロトタイプを2例展示しました。

1つ目のデモは、どこにでもあるバナナを電話に変身させるというものです。ハイスピードカメラでバナナの動きをとらえ、パラメトリックスピーカーから指向性の強いビーム状の音波を送出することにより、あたかもバナナから音が出ているかのような感覚を作り出すことができます。

2つ目のデモは、ピザの箱がノートパソコンになるというもので、映像と音声が箱の蓋に投影され、再生位置を選択したり音量を調整することができます。

このプロトタイプでは拡張オブジェクトを割り出して、オブジェクト上に映像や音声を投射する機能を備えています。現在、拡張現実と呼ばれているものの多くは特殊なメガネなどを必要としますが、この装置ならカメラ付きのiPhoneやiPadでも拡張現実を作り出せます。

研究グループでは、今後、システムが認識可能な動作や対象範囲をさらに拡大して、ユーザーの意図を習得するユビキタスな拡張現実システムをさまざまな場面で実現したいと考えています。